NPU(神經處理單元)作為一種專為人工智能(AI)運算設計的專用處理器,正在逐漸成為現代智能設備中不可或缺的技術。NPU 通過高度並行的架構來優化神經網絡推理和運算,顯著提升 AI 應用的運行效率。隨著 AI 技術在各個領域的迅速發展,NPU 正在加速成為從智能手機到數據中心的核心運算單元,為深度學習、語音識別和圖像處理等應用提供無與倫比的支持。

什麼是 NPU 處理器?

NPU(神經處理單元)概述

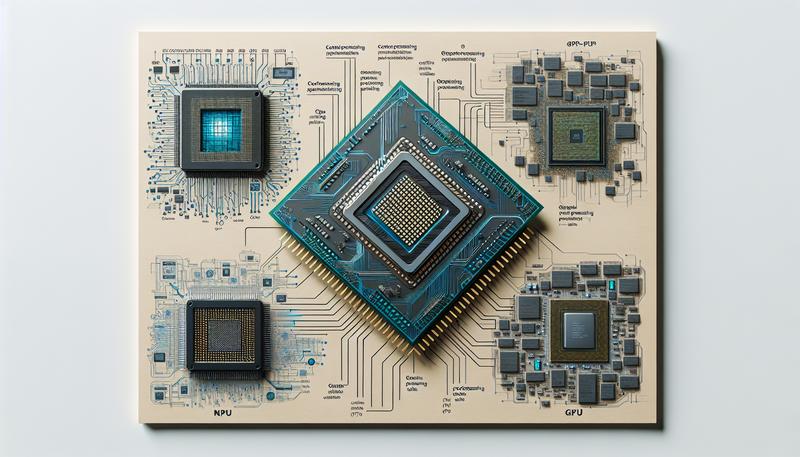

NPU,全稱為神經處理單元,是一種專門為加速神經網絡運算及人工智能(AI)任務設計的專用處理器。與中央處理器(CPU)和圖形處理器(GPU)不同,NPU專注於處理AI所需的特定數學運算,如矩陣乘法、張量運算和卷積操作,因此在深度學習和語言模型等AI任務中具有卓越的效能。隨著AI技術的快速發展,NPU已逐漸成為智能設備中不可或缺的一部分。從智能手機、個人電腦到數據中心,NPU的應用範圍涵蓋了各類產品線,使得各種AI應用場景得以高效實現。

NPU 的運算原理與工作負載

NPU的核心設計理念是通過高度並行的架構來加速AI模型的運算,尤其是針對深度學習算法中大量的矩陣和卷積計算進行優化。NPU的高效性來自其專注於AI任務的特性,如在處理張量計算和繪圖運算時,能顯著降低延遲。與m4晶片及m4系列晶片類似,NPU能在低功耗的情況下高效運作,因此特別適合在智能手機、嵌入式設備中應用,為用戶提供更佳的使用體驗。

NPU 處理器與 AI 技術的關聯

NPU作為AI晶片中的關鍵組件,能顯著提升AI應用的執行效率,特別是在語音助手、語言模型、圖像識別及實時翻譯等場景中展現了卓越的運算能力。相比傳統處理器,NPU針對AI運算進行了深入優化,能在保持低能耗的同時大幅提升效能。這類技術已被如英特爾等公司廣泛應用於其AI產品線,以滿足日益增長的高效運算需求,進一步提升用戶的實際體驗。

隨著AI技術的飛速發展,NPU在更多領域將發揮至關重要的作用,如自動駕駛、物聯網及語言模型的推理運算等。NPU以其專為AI設計的架構,增強了整體運算效能,並為未來智能設備的發展提供了基礎支持。NPU不僅作為一個硬件加速器,還代表著硬件層面的AI技術不斷進步,為各種AI應用的實現帶來更多可能性和創新方向。

NPU、GPU 和 CPU 的差異比較

在現代 AI 應用中,NPU、GPU 和 CPU 各自扮演不同的角色,根據它們的設計與功能特性,這些處理單元在不同的場景中都有明顯的優勢與缺點。以下是三者在 AI 應用中的不同特點及作用分析。

NPU、CPU 與 GPU 的差異:專用性與平行運算

GPU(Graphics Processing Unit) 原本是為了處理圖形渲染而設計的,但其強大的平行運算能力使其逐漸被廣泛應用於深度學習和人工智慧(AI)領域。GPU 擁有成千上萬個小核心,這些核心能夠同時執行大量計算任務,因此在訓練大型神經網絡時非常有效。

CPU(Central Processing Unit) 是通用型處理器,能夠執行多種任務。其設計更適合順序處理,因此在管理操作系統、執行複雜決策和處理多任務方面表現優異。然而,當涉及到需要大量平行處理的 AI 工作負載時,CPU 的效能就顯得不足。

然而,NPU(Neural Processing Unit) 則是專門為 AI 和機器學習任務設計的。與 GPU 不同,NPU 的架構專注於加速神經網絡推理過程,尤其是在邊緣設備和移動設備中,NPU 提供了更高效的運算方式。由於它優化了矩陣運算等神經網絡中常見的操作,NPU 的 AI 特定任務效率遠超 GPU 且耗電量更低。

三者在 AI 應用中的不同角色

在 AI 應用中,CPU 主要負責管理整體系統的運行與協調,處理常規應用程式的操作。GPU 則擅長處理大規模數據並加速平行運算,是訓練 AI 模型和處理大數據集的理想選擇。而 NPU 則專注於神經網絡的推理和訓練,在 AI 相關的工作負載中提供更高的效能和能效,是手機、邊緣設備和實時 AI 推理的最佳選擇。

在現代 AI 系統中,這三者常常協同工作,CPU 負責一般計算與系統管理,GPU 提供平行運算能力,而 NPU 則針對 AI 任務進行加速,以實現更高效的 AI 應用。

Intel NPU 處理器的技術進展

Intel 在近年來持續推動其神經網路處理器(NPU)的技術進展,特別是在其代號為「Meteor Lake」的處理器架構中,首次將 NPU 整合進行動 PC 處理器。這項技術的突破,標誌著 Intel 致力於將 AI 運算深入應用於消費者端設備,並提升處理器在 AI 工作負載下的效率。

Intel NPU 處理器的開發:Meteor Lake 與 AI 運算

Meteor Lake 是 Intel 為了實現 AI PC 時代而推出的新一代處理器,它結合了 CPU、GPU 和 NPU 的多種運算資源。與以往的處理器架構不同,Meteor Lake 採用了模組化設計,將各種計算單元如運算晶片(Compute Tile)、圖形晶片(Graphics Tile)和單片晶片(SoC Tile)分別獨立處理,進而提高整體效能和功耗表現。

其中,NPU 的引入是 Meteor Lake 的一大亮點,這種專門為 AI 推理和運算設計的處理單元,能夠處理生成 AI、影像處理、自然語言處理等多種 AI 工作負載。透過 NPU,AI 計算效能提升,CPU 負載大幅減輕,特別是在處理像是電腦視覺、物體偵測、背景噪音消除等應用上,NPU 的表現尤為出色。

Intel NPU 在 AI PC 的應用

Intel 在推動 AI PC 的發展中,NPU 的整合扮演關鍵角色。Meteor Lake 內建的 NPU,不僅能夠提升 AI 推理效能,更能減少運算過程中的能源消耗。這對於像是筆記型電腦這類常需要在有限電力下高效運算的設備來說,具有極大的應用潛力。

AI PC 的概念並不僅僅局限於硬體,Intel 也開發了相應的 AI 軟體堆疊,支持如 OpenVINO、ONNX 等運算框架,使開發者能夠更輕鬆地利用硬體加速 AI 應用。

Intel Core Ultra 與 NPU 的結合:AI 工作負載的優化

Intel Core Ultra 系列處理器,特別是在 Meteor Lake 和即將推出的 Lunar Lake 架構中,將 NPU 完美融合,成為處理 AI 工作負載的最佳解決方案。根據 Intel 的數據,NPU 在處理 AI 任務時比傳統的 CPU 或 GPU 更加高效,功耗可降低達 8 倍。

這些技術進步不僅將使 AI 工作負載的處理速度大幅提升,還能幫助開發者在更多日常應用中整合 AI 功能,如語音轉文字、背景影像優化、以及視覺效果增強等。

NPU 晶片與 AI 應用的發展趨勢

1. NPU 晶片的架構分析與應用場景

NPU(神經處理單元)是專為 AI 應用設計的處理器,主要目的是優化神經網絡的運行效率。NPU 晶片透過模仿大腦神經元之間的突觸連接來進行數據處理,這使得它能夠更有效地處理 AI 訓練和推理過程。與 GPU 不同,NPU 的架構專門針對 AI 工作負載進行了優化,特別適合用於移動設備和物聯網(IoT)裝置。

NPU 的應用場景非常廣泛,從智能手機到智能家居設備,再到邊緣運算系統,NPU 的低功耗和高效能特性使其成為 AI 發展的關鍵技術之一。尤其在需要實時處理大量數據的場景中,如圖像識別、語音處理等,NPU 可顯著提升 AI 模型的處理速度與精度。

2. 神經處理單元如何優化 AI 訓練與推理

NPU 晶片的核心設計理念在於降低功耗,同時提升並行處理能力,這使其在 AI 模型訓練與推理中展現出極高的效率。透過模擬神經網絡的運作原理,NPU 可以加速深度學習模型的訓練過程,並在推理階段以更低的延遲進行實時運算。這一特性在需要大量推理操作的應用中,特別是自動駕駛、醫療影像分析等領域,發揮了巨大作用。

NPU 晶片還能根據不同的 AI 模型自適應調整其運算架構,使得 AI 模型在執行過程中能夠更加靈活高效。與傳統的 GPU 和 CPU 相比,NPU 的特點是能在更小的空間和更低的功耗下完成高強度的計算任務,這也是 NPU 晶片在移動設備中廣泛應用的重要原因。

3. NPU 晶片在生成式 AI 中的應用

生成式 AI(Generative AI)是近年來快速崛起的一個技術領域,涵蓋了從生成文本、圖像到創造音樂、視頻等不同類型的內容。NPU 在生成式 AI 中的作用不可忽視,特別是在需要大量計算資源來生成複雜內容時,NPU 的高效並行處理能力使得這些任務能夠在移動設備等有限硬體上實現。

此外,NPU 晶片在生成式 AI 的應用不僅僅是提供高效的運算能力,還能通過優化模型運行,降低生成過程中的延遲,進一步提升用戶體驗。例如,在圖像生成和語音合成方面,NPU 能夠快速響應並生成高品質的內容,這對於實時互動和沉浸式體驗的應用來說至關重要。

NPU 處理器概念股的投資潛力

1. NPU 概念股介紹:台積電、聯發科、鴻海

NPU(神經網路處理器)作為專門為 AI 運算加速而設計的處理器,已成為未來科技發展的核心之一。相關的概念股,如台積電、聯發科與鴻海,均在這波 AI 浪潮中占有重要地位。

- 台積電作為全球半導體製造的領導者,受益於各大科技公司對高效能晶片的需求。台積電持續在 3 奈米與 5 奈米製程上進行技術革新,為 NPU 相關晶片提供先進製程支持,成為全球 NPU 晶片生產的重要推手。

- 聯發科在其最新的天璣 9400 晶片中,內建了強大的 NPU,性能比上一代提升 40%,為智慧型手機和其他消費電子產品提供了更高的 AI 運算能力。聯發科藉由這些技術提升,正逐步擴大其市場份額,並加強與高通等大廠的競爭。

- 鴻海則作為全球最大的電子製造服務提供商,積極布局 AI 伺服器代工與邊緣運算裝置生產,並在 NPU 晶片的代工和製造上有深厚的技術積累,成為全球 AI 應用硬體供應鏈的重要成員。

2. 產業競爭格局與 NPU 概念股的發展前景

隨著 AI 技術的快速發展,NPU 成為了各大科技企業競相投入的核心領域。NPU 的低功耗和高效能優勢,使其成為邊緣運算與物聯網設備中的關鍵組件,未來需求將持續增加。

根據市場預測,NPU 應用將廣泛涵蓋終端裝置、邊緣運算和資料中心等多個領域。隨著 5G 網路的普及以及人工智能應用的深入,未來 NPU 市場規模將大幅成長,相關概念股如台積電、聯發科與鴻海等有望從中獲益。

此外,全球各地的科技公司正致力於推出搭載 NPU 的 AI PC 和智能設備,預計到 2026 年,AI PC 的滲透率將達到 50%,進一步推動 NPU 概念股的成長。

3. NPU 處理器公司如何抓住 AI 浪潮中的機會

在這波 AI 技術革命中,NPU 處理器公司可從以下幾個方面抓住機會:

- 技術創新:台積電等公司已投入資源於 3 奈米和 5 奈米技術的開發,以進一步提升 NPU 晶片的效能,這將有助於滿足 AI 計算力日益增長的需求。

- 市場滲透:隨著 NPU 被廣泛應用於智慧型手機、AI PC 及自動駕駛等領域,聯發科、鴻海等公司有機會通過擴大市場份額來增強自身競爭力。

- 產業合作:NPU 公司可以與雲端運算、大數據等領域的領導者合作,推動 AI 應用的整體發展。例如,台積電和鴻海在與國際大廠的合作中,積極參與 AI 伺服器與邊緣運算設備的生產。

NPU 與 AI PC 的未來發展

隨著 AI 技術的快速發展,NPU(神經處理單元)和 AI PC 的應用變得越來越重要。NPU 是專為人工智慧運算設計的硬體,主要負責加速深度學習和機器學習等 AI 模型的運算。未來,NPU 將不僅在手機和智慧裝置中使用,更會成為 AI PC 的核心技術,推動新一代運算平台的發展。

NPU 筆電的性能提升與應用

NPU 筆電的出現為 AI 運算提供了更高效的解決方案。相較於傳統的 CPU 和 GPU,NPU 更專注於處理 AI 模型所需的複雜計算。以 Intel 的 Core Ultra 系列為例,其內建的 NPU 能夠顯著提升生成式 AI 的運算效能,同時降低 CPU 和 GPU 的負載,延長筆電的續航力。這使得 AI 筆電在進行深度學習模型推論時,運算速度加快,而能耗則明顯下降。

目前許多 AI 筆電已經支援如 Stable Diffusion 等生成式 AI 應用,能夠在本地端處理大量語言和圖像生成任務,這對需要頻繁使用 AI 工具的創意產業有極大幫助。隨著 NPU 運算力的不斷提升(如每秒超過 40TOPS 的運算能力),未來筆電將能夠支持更多複雜的 AI 應用。

AI PC 的新趨勢:運算資源與能源效率的平衡

隨著 AI PC 的普及,如何平衡運算資源與能源效率成為一大挑戰。現今的 AI 筆電不僅在硬體上整合 NPU、GPU 和 CPU,還採用了全新的混合架構設計,例如 Intel 的 Meteor Lake 處理器,將四種不同功能的晶片塊整合在一起,使得運算效能和能源效率達到最佳平衡。這樣的設計不僅能有效應對大量的 AI 工作負載,還能顯著降低功耗,特別適合長時間使用 AI 應用的用戶。

NPU 筆電如何支持深度學習模型與機器學習算法

NPU 筆電專為處理深度學習和機器學習的算法而設計。這些筆電具備強大的運算能力,能在本地端進行 AI 模型的訓練和推論,無需依賴雲端計算。特別是在大數據處理、影像識別、語音辨識等應用中,NPU 能夠顯著提高運算速度,並降低延遲。隨著 NPU 技術的不斷進化,AI 筆電的適用場景將會進一步擴大,未來可能在更多的商務和創意應用中發揮關鍵作用。

NPU 處理器的全球市場競爭者

NPU 處理器全球市場競爭者:Qualcomm、AMD 與 Intel

隨著人工智慧(AI)應用的快速增長,神經網路處理器(NPU)的市場競爭愈加激烈。三大科技巨頭 Qualcomm、AMD 和 Intel 都積極在這一領域發展,以提升他們的 AI 計算能力。

Qualcomm 的 NPU 優勢

Qualcomm 的 Snapdragon X 系列處理器基於 ARM 架構,尤其是 Snapdragon X Elite 和 X Plus 系列,已經顯示出強大的 NPU 性能。這些處理器可提供高達 45 TOPS(每秒萬億次運算)的 AI 計算能力,這使得 Qualcomm 成為 AI PC 領域的一個強大競爭者。

AMD 的挑戰與突破

AMD 在 NPU 的競爭中也不甘落後。其即將推出的 Ryzen 8050 平台將引入全新的 XDNA 2 NPU 架構,這將使其性能達到 50 TOPS,超越了其前代產品 Ryzen 7040 系列。這種性能提升將使 AMD 在 AI PC 市場中的地位更加鞏固,尤其是在滿足高端 AI 計算需求上。

Intel 的戰略佈局

Intel 一直以來都是 NPU 技術的主要競爭者之一。Intel 正在推動其下一代 Lunar Lake 處理器,該處理器將搭載達 45 TOPS 的 NPU。與此同時,Intel 也在大力開發新一代 Meteor Lake 處理器,以提升其在 AI 計算市場中的競爭力。

ARM 架構 NPU 的發展現狀與市場應用

ARM 架構由於其高效能和低功耗特性,已經成為眾多 NPU 的首選架構。Qualcomm 和其他晶片製造商利用 ARM 架構設計出具有高效能的 NPU,這些 NPU 已廣泛應用於智慧手機、車用電子以及人工智慧設備中,特別是 AI PC 和 IoT 領域。ARM 架構的靈活性使其適應各種市場需求,從消費性電子產品到工業自動化,未來發展前景廣闊。

台灣科技產業在 NPU 處理器領域的角色

台灣的半導體產業在全球 NPU 市場中扮演了至關重要的角色。台積電等領先企業為全球主要晶片設計公司提供先進的製造技術,支援如 Qualcomm、AMD、Intel 等公司生產出高效能的 NPU。台灣的科技公司憑藉其強大的製造能力和技術優勢,已經成為全球 NPU 市場中的關鍵推動力量。

NPU 處理器在資料中心的應用與優勢

NPU 在資料中心運算中的作用

神經處理器單元(NPU)是專為執行機器學習與深度學習算法而設計的專用處理器。它專注於平行處理大量數據,特別適用於 AI 相關的工作負載,如影像識別和自然語言處理。在資料中心中,NPU 可顯著提升運算速度,尤其是針對需要大量數學運算的 AI 模型,NPU 的加速能力使得 AI 模型的訓練和推論過程更加高效,成為加速 AI 應用的重要元件。

高效能 NPU 處理器如何支持 AI 工作負載

與傳統的 CPU 和 GPU 相比,NPU 更加專注於神經網絡的推理與訓練。NPU 能夠高效處理神經網絡中的大量矩陣運算,這是 AI 模型計算的核心,特別是對於深度學習應用。NPU 的設計讓它能夠在 AI 工作負載中提供比 GPU 和 CPU 更低的延遲和更高的吞吐量,大幅縮短 AI 模型訓練時間,同時降低運算成本,成為資料中心應用的首選技術。

NPU 處理器與能源效率的優化設計

在資料中心運算中,能效優化是關鍵問題。NPU 處理器的設計專注於減少能源消耗,透過針對 AI 任務的專門設計,其處理效率更高、功耗更低,特別是在大規模 AI 應用中。例如,NPU 可以有效分配電力資源,針對每個 AI 計算步驟進行能耗優化,降低總體能耗,這在擴展 AI 應用的同時,能顯著減少資料中心的運營成本。

NPU 不僅是提升運算效能的重要元件,更是在能源效率方面進行了優化,符合未來資料中心可持續發展的需求。

總結

NPU 作為人工智能計算的專用處理器,已經展示出其在加速 AI 應用中的卓越能力。無論是在移動設備中的低功耗應用,還是資料中心的高效能計算,NPU 正在引領未來 AI 運算的發展趨勢。隨著技術的進一步進步和市場需求的增長,NPU 在推動新一代智能技術應用中將扮演越來越重要的角色,成為 AI 生態系統中的關鍵構成部分。

資料來源

- NPU處理器用在哪?NPU概念股有哪些?NPU、CPU、GPU差別是?|數位時代 BusinessNext (bnext.com.tw)

- 【業內觀點】2024 Computex 在台灣預示的未來:NPU 與生成式 AI ,引領下一波個人裝置革命|Eric/每日矽谷|換日線 (cw.com.tw)

- COMPUTEX AI PC火線1/AI PC 登場引爆 NPU 的競爭?英特爾回擊:僅30%用量 | 產業熱點 | 產業 | 經濟日報 (udn.com)