LSTM的出現不僅大幅提升了各類序列任務的表現,還在語音識別、語言翻譯和情感分析等應用中發揮了重要作用,成為現今各種自然語言處理任務的首選工具。

LSTM 是 RNN 嗎?

是的,LSTM(長短期記憶網路)是一種 RNN(遞歸神經網路)的變體,但在功能上有著顯著的改進。RNN 的結構主要依靠迴圈來儲存並更新時間序列中的資訊,這使它非常適合處理序列數據。然而,基本的 RNN 在處理長時間依賴(如語音識別或文本生成)時,經常會遇到梯度消失或梯度爆炸的問題,使得它們在長序列上無法保持穩定的效果。

為解決這些問題,LSTM 引入了「記憶單元」和「閘門機制」,例如輸入閘、遺忘閘與輸出閘,來精確地控制資訊的保留與丟棄,能夠有效保留更長時間的依賴。這些閘門讓 LSTM 能在更長的序列中穩定運作,從而在自然語言處理、語音識別、時間序列預測等應用上顯著優於傳統 RNN。

因此,LSTM 可以被看作是 RNN 的一種改良版本,尤其適用於需要長時間記憶的任務。

LSTM模型是什麼?

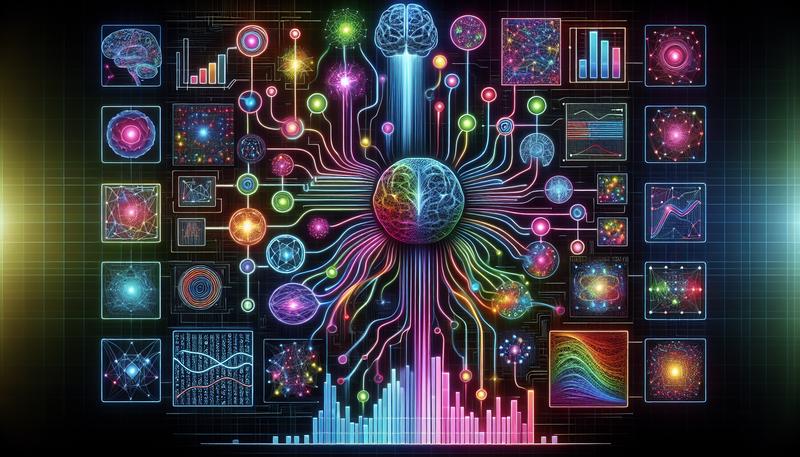

LSTM(Long Short-Term Memory)模型是一種改良的遞歸神經網路(RNN),專門設計來解決長時間依賴的序列數據問題。傳統的RNN在處理長序列時,由於梯度消失和梯度爆炸問題而難以保留長時間的資訊。LSTM的核心在於「記憶單元」以及三個主要的「閘門」:輸入閘、遺忘閘和輸出閘,這些閘門控制了資訊的保留和丟棄,使LSTM能更靈活且有效地在長時間序列中保持記憶。

這些特性讓LSTM在語音識別、語言翻譯、情感分析等應用中非常實用,特別是需要長期依賴的任務,例如在時間序列預測中跟蹤歷史趨勢或處理句子結構的語意上下文。LSTM模型在許多自然語言處理(NLP)和時間序列分析領域中成為首選工具,因為它能夠持續追蹤並保持有意義的上下文訊息,提升預測準確度。

這種架構讓模型在處理序列的時候不僅依賴前文,也能綜合考量後文。

LSTM 誰提出?

LSTM(長短期記憶網路)模型最早於1997年由德國學者Sepp Hochreiter和Jürgen Schmidhuber共同提出。這種創新結構大幅提升了模型在處理時間序列和語意上下文分析方面的表現,因此在語音識別、自然語言處理等領域得到了廣泛應用。

總結

LSTM(長短期記憶網路)是一種改良的遞歸神經網路(RNN),旨在解決傳統RNN在處理長時間依賴序列數據時所面臨的梯度消失和爆炸問題。LSTM由Sepp Hochreiter和Jürgen Schmidhuber於1997年提出,自此在自然語言處理和時間序列分析中成為重要工具,並可與雙向LSTM結合,進一步提升語意理解能力。